女がロボットの中へ入りこむ

(robot43.gif)

動画が沢山貼り出してあるので全部の動画が表示されるまで時間がかかります。

もし、表示されない動画があったらブラウザのリフレッシュボタンをクリックしてください。

(robot43.gif)

(robot40.gif)

(robot41.gif)

(robot44.gif)

(robot45.gif)

(robot46.gif)

(robotbg.jpg+balloons2.gif)

(junko05.gif)

(chatgpt10b.jpg)

デンマンさん。。。、今日は女がロボットの中へ入りこむ というお話ですかァ〜?

(kato3.gif)

そうです。。。いけませんか?

かまいませんけれど、どういうわけで女がロボットの中へ入りこむ という事に興味を覚えたのですかァ〜?

実は、Xで呟いているときに次の動画を目にしたのですよ。。。

(robotx.jpg)

(gal-driven-robot2.gif)

ロボットの中に20代の若い女性が入って、計器を操作して走り出したと思ったのですよ。。。いかにも素人っぽい女性が、ロボットを簡単に操作して、このように自然に走り出すことができるのか? 僕は不思議に思ったのです。。。技術的にどのような仕組みになっているのだろうか?

あのねぇ〜、デンマンさん、「人がロボットに入って操作している」と見えるでしょうけれど、これは「ロボットスーツ/操縦型メカニカルスーツ(メカ)」の一種であり、必ずしも自律型のロボットではありません。

そうですか。。。でも、巨大なロボットのような構造物に人間が入って操作するようなロボットをかつて僕は、映画で見たことがあるのですよ。。。

ええ。。。実際に人が中に入るタイプのメカ(メカスーツ)というのもあるのですよ。。。かつて韓国の METHOD-1 などの「人が乗って操縦する巨大ロボット」プロトタイプが開発されており、操作者の動きがロボットの動きに反映される仕組みがあります。

①人がロボトに入って

操作している場合

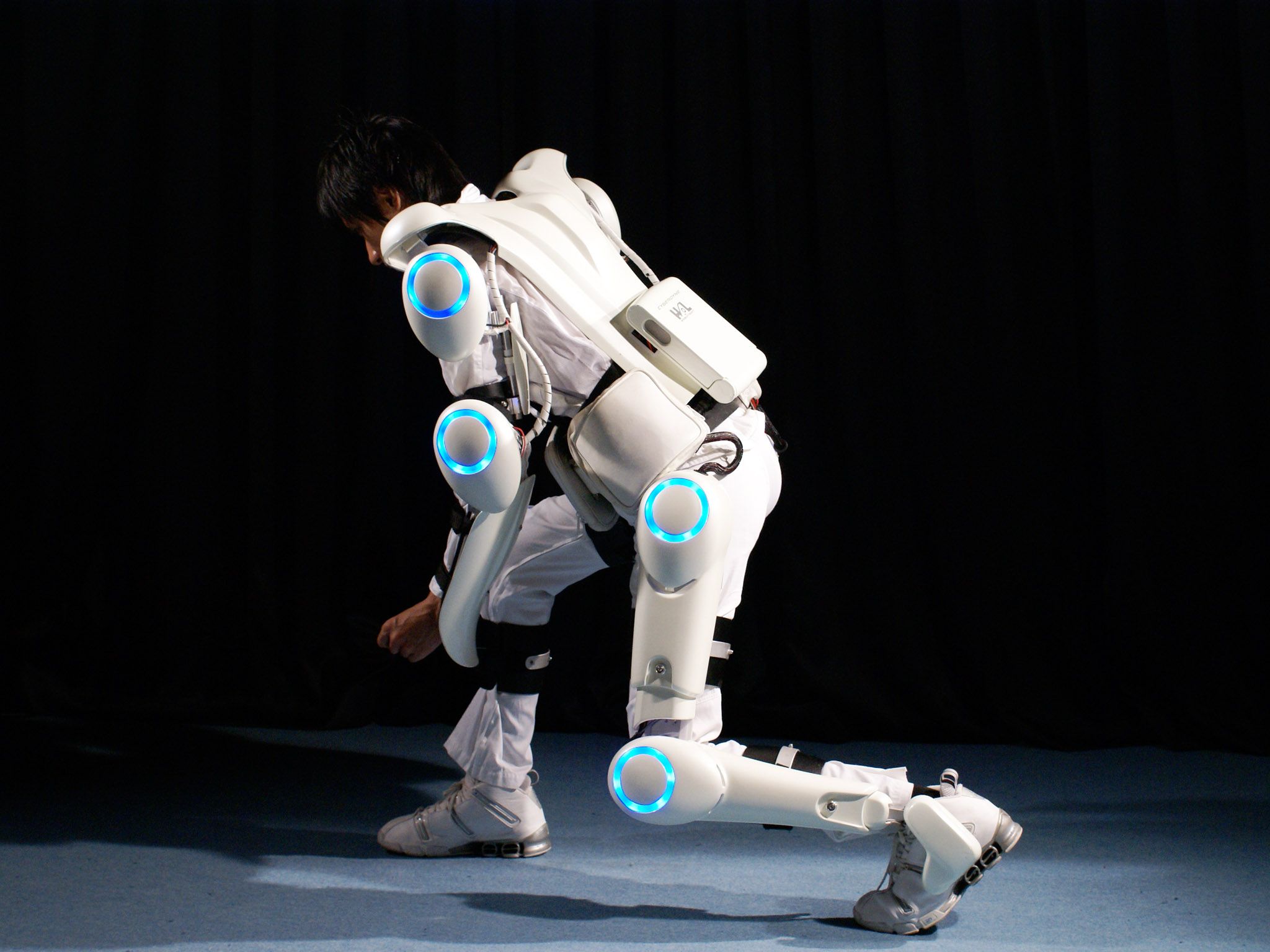

エクソスケルトン(パワードスーツ)

Robot suit のような装置で、ユーザーの動きや入力をセンサーで読み取り、関節やモーターで増幅して動きを実現します。

代表例として、日本の「HAL(Hybrid Assistive Limb)」のような人が装着して動くロボットスーツがあります。

(Hybrid_Assistive_Limb2.jpg)

このタイプのロボットは

✔ 動きは人間の操作に依存

✔ 動きの自由度はセンサー+制御によって制御

という特徴があります。

操作が 「簡単に見える」かについては:

📌 操作自体は人間の動きを反映するだけなので、体の自然な動き(歩く/手を動かすなど)で制御できます。

📌 ただし装着・慣れ・安全面は専門の訓練や補助が必要です。

📌 現実の巨大スーツ型ロボットは重くてバランス制御が難しく、単純に「素人が初見で自在に走る」というのはまだ技術的に簡単ではありません。

🎮 ②「遠隔操作 /

テレオペレーション

(teleoperation)」の場合

動画のように見える動きが 本人の動作そのままではなく、遠隔/外部操作で動いている可能性もあります。

遠隔操作の仕組み:

テレオペレーション

人が別の場所にいて、センサーやコントローラで動きを送信し、ロボットがそれを再現して動く方式。

例として ANA Avatar XPRIZE など、誰でも扱えるような遠隔操作の技術競技があるほど研究が進んでいます。

Impress Watch

VR+力覚フィードバック

コントローラやセンサーを介して手の動きを読み取り、ロボットが動く方式(力覚フィードバックがある研究も進んでいます)。

arxiv.org

このような操作では「素人でもすぐに扱えるような GUI や簡易操作パネル」があり、ボタンで歩行モードを切り替えるような補助も多いです。

📊 ③ 技術的にどんな仕組みに

なっているのか?

主要な方法を整理すると:

✅ センサーインタフェース

ユーザーの動きを読み取る装置(モーションキャプチャ、ジャイロ、傾きセンサー、IMU、力センサーなど)。

✅ エクソスケルトン / パワードアクチュエータ

ロボット側の関節を動かすモーターや油圧/電動アクチュエータ。

これは人の動きを増幅したり、ロボットの脚や腕を動かすための主要部品です。

✅ コントロールアルゴリズム

センサー入力を適切なモーター駆動指令に変換する制御系。

リアルタイム性が重要で、バランスを取るために歩行制御が組み込まれていることが多いです。

✅ フィードバックシステム(場合によって搭載)

触覚や力覚を返すシステム(例:ロボットが転びそうになると警告や抵抗を返す)。

SciTechDaily

🧑🔧 素人の女性でも操作は

本当に簡単?

結論:使う技術によりますが、全く説明不要に自由自在という段階ではないです。

✔ 動きの基本操作(歩く/曲げるなど)は、ユーザーの自然な動きで制御可能。

✔ しかしバランスや安全方向の制御、初期セットアップ、装着・脱着・保護措置などには訓練とサポートが必要です。

つまり、

👉 動きそのものは直感的でも

👉 完全に安全に自在に操れるには今の技術では「簡単だ」とは言い切れません(補助や補完制御が重要)。

🧠まとめ

操作形態

①人が直接入るロボットスーツ

内容: 人の動きを機械的に反映

素人でも扱えるか?: 部分的に直感的だが安全/バランスは難

②遠隔操作 / テレオペレーション

内容: 別の場所からコントローラで操作

素人でも扱えるか?: UI 次第で比較的扱いやすい

③完全自律型ロボット(AI 自動動作)

内容: 人の指示を解釈して自立運動

素人でも扱えるか?: まだ研究段階で一般には難

必要であれば、

🔹 その動画が本物のロボットか、人が中に入っているだけかの見分け方

🔹 現実に存在するロボットスーツの種類や仕組み(例:HAL、METHOD-1 など)

を詳しくビジュアルで解説できます。

興味ありますか?

興味あります。 わかり易く説明してください。

いいですね!では 実際に「人が入って操作するロボット/着るロボット(エクソスケルトン)」 の実例と仕組みを、わかりやすくビジュアルとともに解説します。

🤖 1. そもそも「エクソスケルトン」

「パワードスーツ」とは?

(170217-exoskeleton-mn-1810.jpg)

(dc8e2/MicrosoftTeams-image_9.jpg)

(Guardian-XO-Alpha-Up-Close-and-Personal-with-the-Sarcos-Robotics-Full-Body-Powered-Exoskeleton.jpg)

エクソスケルトン(外骨格ロボット)は

→ 人間の体外に装着して動きを助けたり強化したりするロボットです。

歩行補助、荷物持ち支援、リハビリ支援など実用化が進んでいます。

🔹 動きを読み取って補助・強化する

→ 筋電センサーや関節角センサーで人の意図を読み取り、モーターで動きをサポートします。

🔹 ロボットと言っても実際は「装着する服のようなロボット」

→ 動きはユーザーの入力に基づいているので、ある程度直感的に動かせます。

🦾 2. 実例:HAL(ハイブリッド-

アシストリム)

(MicrosoftTeams-image_9.jpg)

(Hal.jpg)

(b46cc799a54dcd30d339d587370b610a02bf45e7-2048x1536.jpg)

HAL(Hybrid Assistive Limb)

• 日本のCyberdyneが開発したパワードエクソスケルトン。

• 神経から出る微弱な電気信号をセンサーで検出し、歩こうとする意図を補助して動く仕組み。

• 医療・リハビリ用として病院で使われており、実際に階段昇降などの補助も可能。

👉 ポイント

・ユーザーの意図に合わせて動く=直感的ではある

・でも装着やバランスはトレーニングや補助が必要

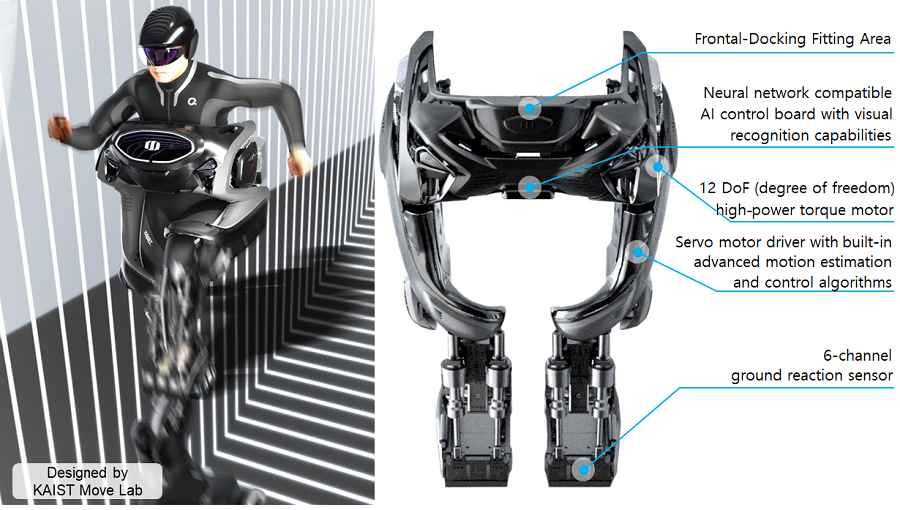

🤝 3. 先進例:WalkON Suit F1

(韓国・KAIST)

(lab-img-v2.jpg)

(washingtonpost-F13)

(Image_4_900.png)

WalkON Suit F1

• 韓国KAISTチームが開発した歩行支援ロボット。

• 12個のモーターで自然な関節の動きを模倣し、バランス・段差対応も可能。

• センサーが1秒間に1000回以上データ処理し、ユーザーの動作意図を読み取りながら歩行を支援。

👉 特徴

✔ パワーアシストだけでなくバランスと環境認識も搭載

✔ 車椅子から装着できる設計など「使いやすさ」も改良中

🦿 4. 「巨大ロボットに乗る」の例:

METHOD-1

(4668_n.jpg)

(1837.gif)

(images_000066_Photo_1.jpg-1-768x431.jpg)

METHOD-1は

→ 巨大な人型ロボットで、「搭乗して操縦する」タイプの試作機。

→ 操縦席から腕や指の動きを反映して制御するコンセプトロボットです。

👉 ポイント

✔ 実際に人が乗る形式

❌ でもこれもまだプロトタイプで実用化には至っていません

🧠 5. 仕組み簡単まとめ

(A)センサー入力 → 補助動作

人間の体の動き/神経信号 → センサー検知 → モーター/アクチュエータで補助動作。

(B)AI・制御システム

最新のものはAI制御でより自然な動きや省エネ化も実現しつつあります。

(C)安全と補助

直感的に動かしやすいですが、バランスや転倒防止のため安全機構や補助が必須です。

🧍♀️ 素人の人でも操作できるの?

✔ 基本操作は意図に合わせて動くので比較的直感的(歩く・曲げるなど)

✔ ただし実際の装着・バランス補助・安全面では訓練や補助が必要

→ 今の技術では「初心者が一度見ただけで自由自在」というレベルではなく、補助制御・安全設計で支えられて動くという形です。

📌 まとめ(簡単版)

種類

①エクソスケルトン(HALなど)

操作方法: 人の動きを補助・増強

実用性: 医療・作業支援で実用化済

②先進バランス支援型(WalkON Suit F1)

操作方法: 人の意図 + 自動バランス制御

実用性: 研究・試験進行中

③巨大ロボット搭乗型(METHOD-1)

操作方法: 人が中で操作

実用性: プロトタイプ段階

質問があれば、

🔹 このロボットはどこまで実用化されている?

🔹 動画のようなタイプが本当に操縦可能か見分ける方法は?

など、さらに詳しく説明できますよ!どれを知りたい?

ロボットはどこまで実用化されているのですか

とてもよい質問です。

結論から言うと、「ロボットは分野によって“完全に実用化されているもの”と、“まだデモ・研究段階のもの”がはっきり分かれている」というのが現状です。

以下、2025年時点での実用化レベルを分野別に整理します。

① すでに「本格実用化」している

ロボット

🏭 産業用ロボット(完成度:★★★★★)

これは最も成熟しています。

例

工場の溶接・組立・塗装ロボット

半導体製造ロボット

倉庫の自動搬送ロボット(Amazonなど)

特徴

人より正確・高速・疲れない

決まった環境で決まった作業をするのが得意

人間の介入は最小限

👉「ロボット」と聞いて最も成功しているのは実はこの分野です。

🏥 医療・介護ロボット(完成度:★★★★☆)

● 手術支援ロボット

ダヴィンチ(da Vinci):世界中で実際に使われている

医師が操作するが、手ブレ補正・精密動作はロボットが担当

● 歩行支援・介護支援ロボット

HAL(日本)

ReWalk

Ekso

できること

歩行補助

立ち上がり補助

リハビリ支援

できないこと

自分で考えて自由に動く

不整地を人間並みに歩く

👉

「限定された目的」では十分に実用化されています。

🏗 建設・物流支援ロボット(完成度:★★★☆☆)

例

重量物を持つためのパワードスーツ

倉庫内のピッキングロボット

建設現場の遠隔操作重機

ポイント

「人を完全に置き換える」のではなく

👉 人の能力を底上げする道具

操作は比較的簡単だが、訓練は必要

② 「条件付きで実用化」している

ロボット

🚶

️ ヒューマノイド(二足歩行ロボット)(完成度:★★☆☆☆)

例

Boston Dynamics「Atlas」

Tesla「Optimus」

Figure AI の人型ロボット

できること

歩く、走る、物を持つ(デモ環境)

決められたタスクを繰り返す

できないこと

一般家庭での安定稼働

人間並みの柔軟判断

安価な量産

👉動画で見るとすごいが、まだ“ショーケース段階”です。

🤖 人が中に入るロボット・ロボットスーツ(完成度:★★☆☆☆)

デンマンさんが最初に見た動画のタイプです。

現状

小型エクソスケルトン → 実用化済み

巨大ロボットに入って走る → ほぼデモ・演出

なぜ?

重量

転倒リスク

エネルギー効率

法規制と安全性

👉「走って暴れ回る巨大ロボット」は、現実ではまだ危険すぎるのが正直なところです。

③ まだ「研究・未来技術」段階の

ロボット

🧠 完全自律型・人間並みロボット(完成度:★☆☆☆☆)

未達成の理由

人間の身体制御があまりに高度

バランス・判断・予測が難しすぎる

電池・アクチュエータが未熟

現状

AIは「頭脳」としては進化

しかし「身体」はまだ追いついていない

👉知能より「体を動かす方が圧倒的に難しい」というのがロボット工学の現実です。

④ では、動画のようなロボットは

「ウソ」なのか?

❌ 完全なウソではありません

⭕ ただし強い演出が入っている可能性が高い

よくある手法:

軽量外装(中は人がほぼ歩いている)

動きを誇張するカメラアングル

安全補助を編集でカット

実験環境のみで撮影

👉「素人の女性が自由自在に操縦している」ように見せることは、映像的には可能です。

🔑 まとめ(超重要)

ロボットは

「工場・医療」では完全実用化

「人型・巨大ロボット」はまだ未来

人が中に入って操作するタイプは

👉 補助付き・限定用途なら実用

👉 走り回るレベルはまだ演出寄り

今は「人を置き換える」より「人を支援する」段階

分かりやすい説明で、最近のロボットや支援スーツの開発の現状が理解できました。ありがとうございました。

いいえ、どういたしまして、お役に立てて嬉しいです。。。

(laugh16.gif)

【ジューンの独り言】

(bare02b.gif)

ですってぇ~。。。

あなたも、シナリオを作って、AI動画サイトでビデオを作ってみませんか?

AIが手を加えて予期しないほど素晴らしい動画を作ってくれます。

ええっ。。。 「そんなことは どうでもいいから、他に何か面白いことを話せ!」

あなたは、そのように わたしにご命令なさるのですかァ~?

分かりましたわ。。。では、あなたも信じられないような人間を紹介しますわ。。。うふふふふふ。。。

(onara-visual.gif)

試してみてください。。。もし、できるなら、あなたもタレントになってテレビで人気者になれるかもしれませんわァ〜。。。

ええっ。。。 「そんなバカバカしい動画は どうでもいいから、他に何か もっと面白いことを話せ!」

分かりましたわ。。。 じゃあ、更に面白い動画をお目にかけますわ。。。

ワンワンちゃんが人間の言葉をしゃべります!

(dog810.jpg)

ええっ。。。? 「そんな馬鹿バカしい動画など、どうでもいいから、何か他に面白い話をしろ!」

あなたは、また そのような命令口調で わたしに強要するのですか?

わかりましたわァ。。。

では、たまには日本の歴史の話も読んでみてくださいなァ。

日本の古代史にも、興味深い不思議な、面白いお話がありますわァ。

次の記事から興味があるものをお読みくださいねぇ~。。。

同腹の兄弟ではなかった。

どうして残っていないの?

日本人でないの?

藤原氏のバイブルとは?

ところで、他にも面白い記事がたくさんあります。

興味のある方は次の記事も読んでみてくださいね。

(sunwind2.gif)

(sylvie500.jpg)

(ken203h.jpg)

(teacher9.jpg)

(miya08.jpg)

とにかく、今日も一日楽しく愉快に

ネットサーフィンしましょう。

じゃあね。バーィ。

(hand.gif)

(spacer.gif+betty5de.gif)

(hiroy2.png+betty5d.gif)

『HIRO 中野 せどり スパマー』

(surfin2.gif)

ィ~ハァ~♪~!

メチャ面白い、

ためになる関連記事

(himiko92.jpg)

■ "JAGEL - Soft Japanese Bagel"

(linger65.gif)

(beach02.jpg)

(rengfire.jpg)

(byebye.gif)

0 件のコメント:

コメントを投稿